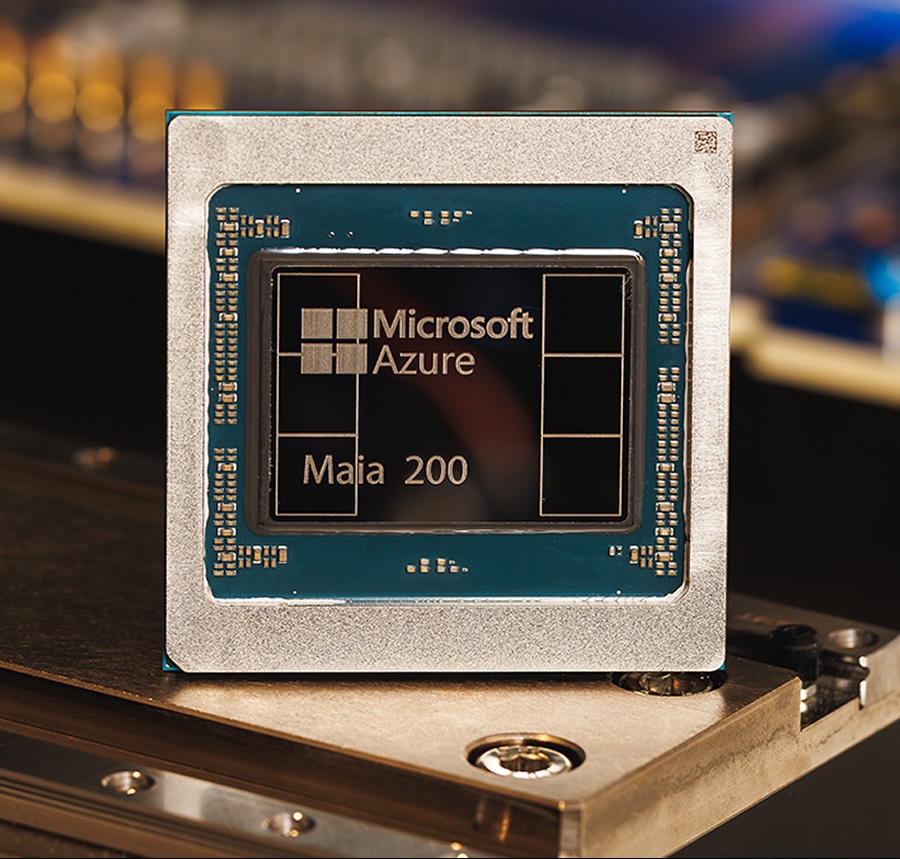

Microsoft推出Maia 200晶片 大幅提升大型AI模型效能與成本效益

Microsoft最近推出Maia 200晶片,為其端到端的AI基礎建設發展立下重要里程碑,大幅提升大型AI模型的效能與成本效益。Maia 200是Microsoft至今部署過最高效能的AI推理系統,每美元效能較現有系統高出30%。其FP4推理效能是亞馬遜第三代Trainium的三倍,FP8則超越Google第七代TPU。

晶片效能的重大突破

Maia 200的單一節點能輕鬆處理目前規模最大的AI模型,全賴以下技術基礎:

- 為大規模 AI 工作負載而設的台積電 3 納米製程

- 提升低精度運算效能的原生 FP8/FP4 張量核心

- 配備頻寬達 7 TB/s 的 216GB HBM3e 和 272MB 片上 SRAM 的記憶體系統,以及能讓大型模型保持快速且高利用率運行的數據傳輸引擎

統一的高速網絡架構

Maia 200採用統一的乙太網絡架構,為各節點、機架與叢集提供可擴展、可靠且高效的網絡連接能力。整體網絡架構結合每個加速器 1.4 TB/s 的網絡頻寬、硬件托盤模組內的直接連接設計,以及貫穿整個系統的 Maia AI 傳輸協議,使系統得以無縫擴展,同時降低耗電量與總生命週期成本,進一步提升其網絡架構的靈活度、效率,以及雲端規模的效能。

實現與數據中心無縫整合為設計核心

Maia 200自研發初期已着重與數據中心的無縫整合,研發團隊已率先對最複雜的系統組件進行驗證,包括其後端網絡架構,以及Microsoft第二代閉環液冷式熱交換單元,確保系統由投入運作開始即可達至高度可靠。

Microsoft已開始在其AI生態系統中部署Maia 200。Microsoft超級智慧團隊將率先利用Maia 200進行合成數據生成和強化學習,其後亦會陸續用於為Microsoft Foundry及Microsoft 365 Copilot提供運算能力,最終將服務延伸至全球客戶。透過統一的設計框架結合晶片、AI模型與應用程式,Microsoft得以提升端對端架構的整體運作,為企業和用戶帶來更高效能、更具成本效益,以及更一致的AI體驗。