Microsoft首份負責任AI透明度報告 量度和管理生成式AI風險

Microsoft在過去8年來,一直在負責任AI方面不斷創新。在首份年度《負責任AI透明度報告》中,Microsoft分享如何開發以生成式AI驅動的應用程式,作出相關決策並監察這些應用程式的部署,支援客戶開發自身的生成式應用程式,以及與整個負責任AI社群一起繼續學習、發展和成長。

為支持客戶發展負責任AI,Microsoft已經落實了以下措施:

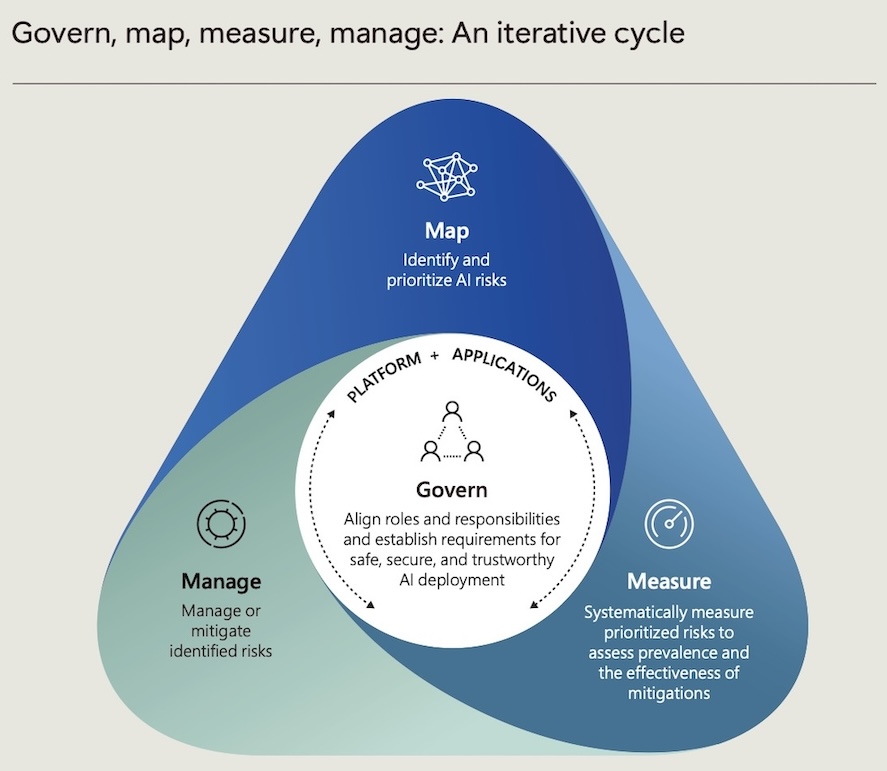

- 推出30個負責任AI工具,提供逾100種功能,以偵測和量度AI風險,並透過嶄新的防範方法、即時檢測和過濾,以及持續監測來管理已識別的風險。

- 自2019年以來發佈了33份透明度報告,為客戶提供有關其平台服務的詳細資訊。

- 於2023年公佈其AI客戶承諾,包括制定和宣佈 AI 保障計劃、負責任AI合作夥伴計劃和客戶版權承諾等措施。

Microsoft將於四個關鍵範疇繼續投入發展,以助業界拓展負責任AI:

- 探索創新的負責任AI產品開發模式,在Microsoft產品中應用。

- 研發工具以協助客戶負責任地開發AI應用程式。

- 與整個負責任AI生態圈分享Microsoft的經驗和最佳實踐。

- 支援制定相關法律、規範和標準,過程中涵蓋與各持份者廣泛而包容的討論。

Microsoft認為負責任的人工智慧沒有終點線。雖然這份報告沒有給出所有答案,但我們致力於儘早並經常分享我們的經驗教訓,並圍繞負責任的人工智慧實踐進行積極的對話。我們邀請公共、私人組織、非營利組織和管理機構使用第一份透明度報告來加速我們在世界各地已經看到的負責任的人工智慧的令人難以置信的勢頭。

如欲了解更多資訊,按此瀏覽完整報告。